Intervista ad Alessandra Sciutti, coordinatrice del COgNiTive Architecture for Collaborative Technologies Lab di IIT

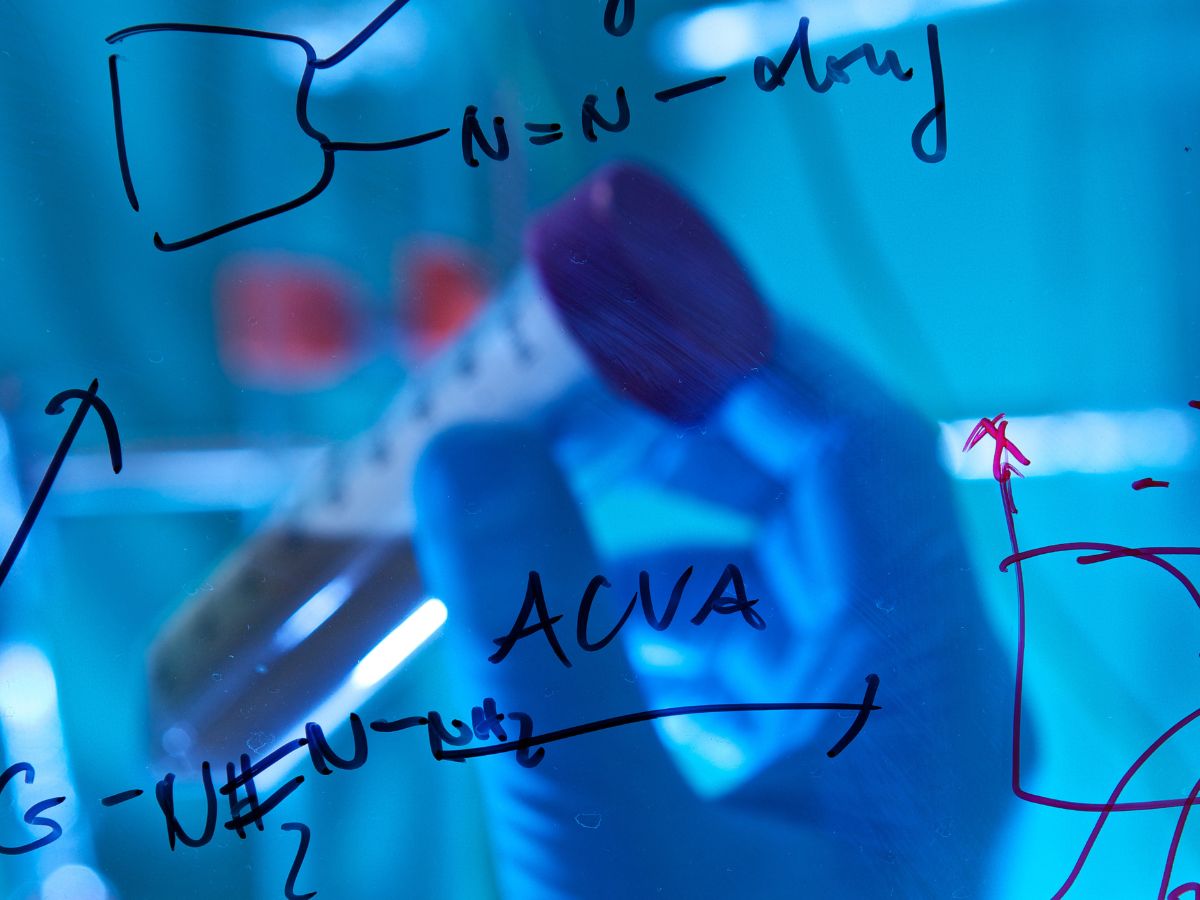

Tutti noi, ogni giorno, ci illudiamo di vedere il mondo che ci circonda per quello che è. Ma non è così. Il nostro cervello mette in moto dei meccanismi che, a seconda della circostanza in cui ci troviamo e dell’esperienza passata, modificano la nostra percezione del modo. Il progetto wHiSPER, finanziato dall’ERC e guidato da Alessandra Sciutti – coordinatrice dell’unità COgNiTive Architecture for Collaborative Technologies dell’Istituto Italiano di Tecnologia –, mira ad approfondire questi meccanismi percettivi di tempo e di spazio, studiando come la nostra percezione si modifichi durante un’interazione con un altro essere umano o con un robot.

Di seguito, l’intervista ad Alessandra Sciutti.

Per studiare e riprodurre le percezioni in un robot, partite dallo studio delle percezioni umane?

Il vero obiettivo del progetto è proprio quello di riuscire a capire come noi esseri umani riusciamo a stabilire una percezione condivisa con gli altri, che è quello che ci permette di collaborare facilmente, in maniera intuitiva e senza fatica. La speranza è che, dopo aver capito questi meccanismi, sia poi possibile far sì che anche le tecnologie collaborative, in particolare la robotica, possano diventare capaci di adattarsi e quindi venirci incontro. Ad oggi, quando ci interfacciamo con la tecnologia, tutto è a carico nostro: in altre parole, siamo noi ad avere il totale controllo, ma anche l’onere di adattarci al “linguaggio” della macchina. Lo studio che stiamo portando avanti è molto incentrato sull’uomo: il robot è prima di tutto uno strumento per studiare meglio l’essere umano. Tuttavia, questa ricerca potrebbe avere un’importante ricaduta tecnologica, come quella di avere nuove tecnologie collaborative che vedono il mondo come noi.

In che modo studiate i rapporti umani (potremmo dire l’interazione uomo/uomo)?

Usiamo tradizionali modelli psicofisici: si tratta di misure che sono sempre state utilizzate per capire come avviene la percezione dello spazio e del tempo nell’essere umano. Ma, per la prima volta, raccogliamo questi dati non in un contesto individuale (dove la persona è da sola in un determinato spazio e per un certo intervallo di tempo), ma in un contesto collaborativo, in cui cioè una persona interagisce con un altro individuo e/o con un robot. Questo ci consente di osservare che il nostro cervello non funziona allo stesso modo quando siamo soli e quando siamo in compagnia: i meccanismi percettivi del nostro cervello funzionano diversamente, cambiando la nostra visione del mondo fisico, a seconda che siamo soli oppure no. La nostra percezione è sì guidata da ciò che ci circonda realmente, ma il cervello elabora la realtà sulla base delle esperienze passate e delle conoscenze pregresse. È quello che si rivela spesso quando, ad esempio, siamo messi di fronte alle illusioni ottiche, per cui mescoliamo il mondo fisico con ciò che è reale solo nel nostro cervello. Essendo il cervello influenzato dall’esperienza, può facilmente accadere che due persone abbiano percezioni diverse della stessa cosa.

Se ognuno di noi può percepire in maniera diversa una stessa cosa, come è possibile creare un modello che spieghi più in generale il funzionamento dei meccanismi percettivi dell’essere umano?

È stato recentemente scoperto che, quando noi esprimiamo dei giudizi molto semplici, come affermare quanto sia lunga una linea, la percezione che abbiamo della lunghezza dipende anche dalla “storia” della linea stessa. In altre parole, se io ti mostro l’immagine di una linea e successivamente una serie di linee molto corte, quando ti mostro nuovamente l’immagine iniziale, tu percepisci quella linea più corta di prima. Viceversa, se ti mostro una serie di linee molto lunghe e successivamente la medesima linea, tu la percepisci più lunga. Il cervello, cioè, arricchisce e modifica la tua percezione sulla base dell’esperienza passata. E perché lo fa? Perché, facendo una serie di assunzioni, fa sì che la percezione che abbiamo risulti il più possibile stabile nel tempo. È un approccio ottimale, quello del cervello, e lo si può dimostrare. Sebbene il singolo giudizio sulla lunghezza della linea sia meno accurato, in generale questo paga in termini di errori. In altre parole, il tuo cervello compie complessivamente meno errori. Questo meccanismo è modellizzabile sulla base di esperimenti come quello delle linee, ma si applica anche alla percezione di altre grandezze, come ad esempio la percezione della durata di un intervallo di tempo.

Questi modelli funzionano anche quando interagiamo con un altro individuo o con un robot?

Nel momento in cui devi misurare le percezioni spazio-temporali di un individuo che sta interagendo con altri individui o con un robot, la situazione cambia. In tal caso, misuriamo infatti come si modificano certe proprietà elementari – come la durata o l’ampiezza – della percezione di una persona sotto l’effetto di stimoli esterni, cioè sotto l’effetto di una serie di azioni compiute da un robot o da un’altra persona. L’ambizione è proprio quella di approfondire il funzionamento di questi modelli. Nessuno fino ad ora aveva ipotizzato che i meccanismi di ottimizzazione alla base della percezione potessero cambiare per contatto interattivo.

Altro aspetto molto importante per noi, che costituisce il passo successivo della nostra ricerca, è fare in modo che il robot segua questi modelli. Non vogliamo, quindi, che la percezione del robot sia accurata al cento per cento come la risposta che proviene da un sensore, ma che sia piuttosto arricchita dalla sua esperienza, proprio come accade nel cervello umano. In questo modo, vogliamo rendere il robot consapevole di come noi vediamo il mondo, in modo che possa adattarsi a noi e alla nostra prospettiva.

Se io osservo le azioni di un altro individuo e osservo quelle di un robot, la mia percezione rimane la stessa o cambia nei due casi?

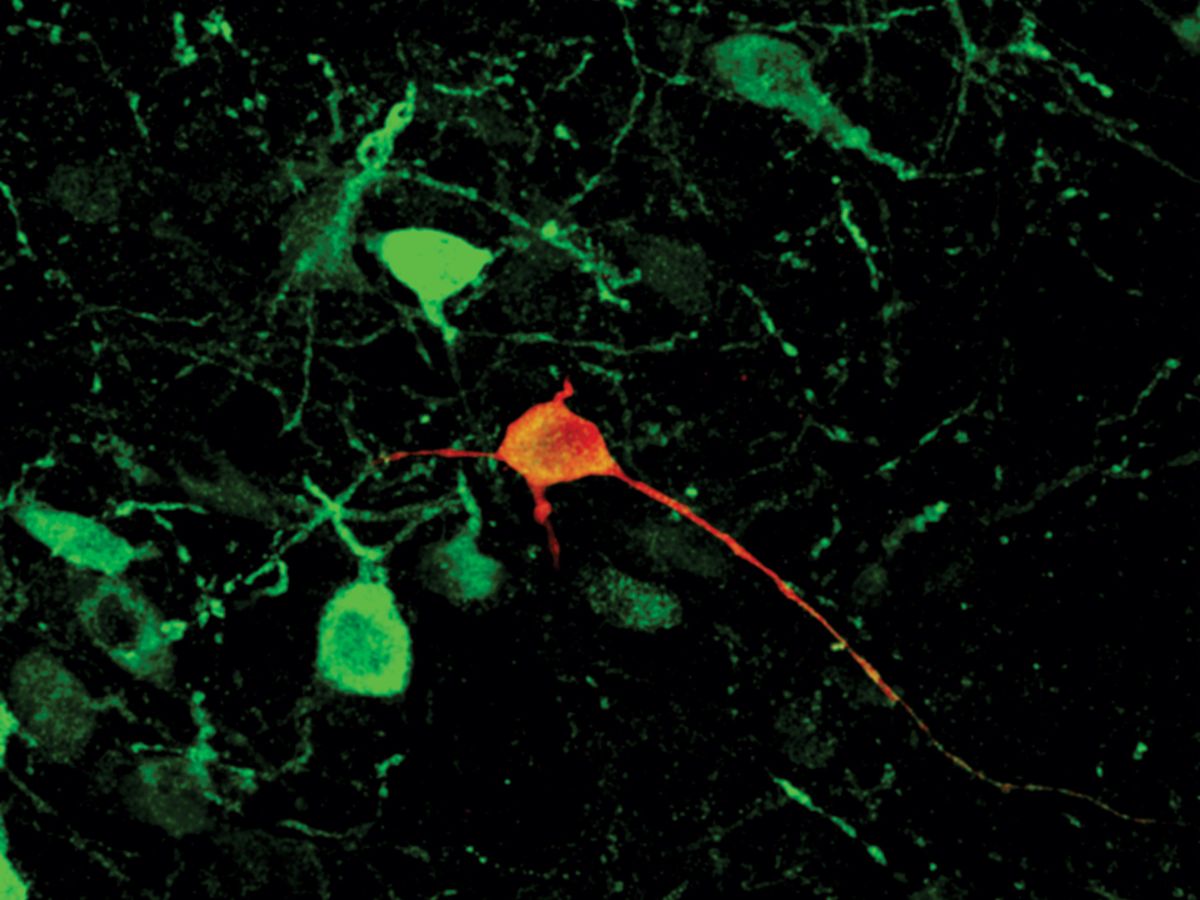

Questa è una delle domande della nostra ricerca. Io lavoro su un robot umanoide, quindi la sua struttura e i suoi movimenti richiamano quelli di un essere umano. Questo è un aspetto molto importante. Nella nostra ricerca abbiamo trovato che molti fenomeni, come quelli associati ai neuroni specchio (per esempio, l’imitazione automatica della velocità di un movimento), possono verificarsi anche durante l’interazione con un robot. Tuttavia, esistono regole precise su come il robot debba muoversi: esso deve seguire, cioè, delle regolarità di movimento, che se rispettate determinano una nostra reazione automatica equivalente a quella che avremmo durante una collaborazione con un umano, altrimenti non funzionano. Un esempio: il profilo di velocità e lo stile dei movimenti che un robot segue, deve rispecchiare quelli associati al nostro controllo motorio.

Perché è importante che un robot rispetti queste regolarità di movimento?

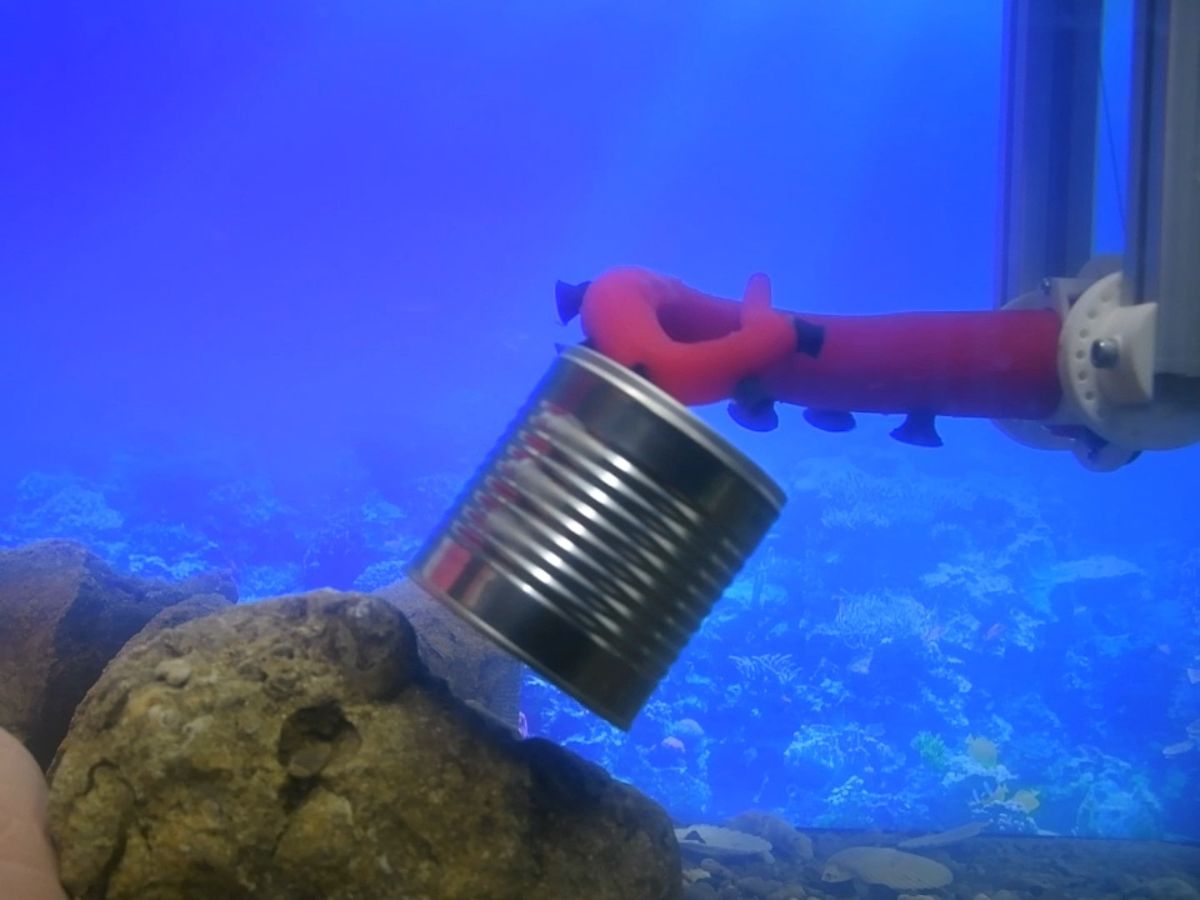

Per fare un esempio, quando qualcuno ti passa un oggetto, una parte del tuo cervello (l’insula) percepisce immediatamente se l’altra persona stia compiendo questa azione in maniera aggressiva o gentile. E lo percepisce da una serie di parametri, come lo stile e la velocità. Con Giuseppe Di Cesare ed altri collaboratori nel mio gruppo, trasferendo a un robot i dati relativi alle proprietà dei movimenti (come l’accelerazione o l’intero profilo di velocità), abbiamo dimostrato che non solo le persone riconoscono a voce la maniera con cui il robot compie un’azione, ma che l’attivazione dell’insula è molto simile a quella che si osserva quando questi individui assistono alla stessa azione compiuta da un essere umano.

Tutto ciò ha un impatto significativo sull’evoluzione dell’interazione, perché se percepisco un movimento aggressivo del robot, senza rendermene conto risponderò in maniera aggressiva. Al contrario, se il robot assume dei movimenti gentili, di conseguenza anche io mi comporterò in maniera gentile. Nel momento in cui interagiamo, c’è quindi un contagio dello stile che adottiamo. È stato inoltre provato per la prima volta che, se osservi un robot che compie delle azioni in modo meccanico, senza introdurre alcun comportamento sociale, percepisci le proprietà delle sue azioni, ad esempio l’ampiezza, come se fossi da solo. Se invece il robot compie le stesse identiche azioni, ma interagendo con te (per esempio, ti guarda e ti sorride), la tua percezione cambia significativamente, utilizzando una diversa ottimizzazione e diventando più accurata.

Ricapitolando, quali sono i passaggi che dovete compiere per portare a termine questo studio?

Partiamo da misure di interazioni uomo/uomo. Raccolti questi dati, a quel punto realizziamo un modello. Il passo successivo è misurare le proprietà di percezione umana nell’interazione uomo/robot, in cui tuttavia il robot è soltanto uno stimolo, poiché non vi abbiamo ancora implementato alcun modello: vogliamo cioè ricreare un contesto interattivo in cui l’uomo lavora con il robot, avendo però un totale controllo su tutto ciò che la macchina esegue. L’ulteriore passo è lo studio delle percezioni nell’interazione uomo/robot, in cui questa volta il robot non è uno stimolo bensì un modello: i dati raccolti vengono cioè trasferiti alla macchina, che percepirà il mondo fisico non per quello che è, ma sulla base della sua esperienza.

Quindi, anziché avere un robot che abbia la precisione di un sensore, avremo un robot che include le distorsioni della percezione umana. Ma perché volere una macchina meno accurata e precisa?

Solo in questo modo possiamo davvero interagire con la tecnologia. Quando ci interfacciamo con un robot, ci aspettiamo che esso percepisca il mondo fisico come lo percepiamo noi. Ma non è così, almeno che la macchina non abbia appreso un modello esatto del modo in cui noi percepiamo. D’altra parte, non possiamo chiedere al nostro cervello di implementare i dati precisi e accurati di un sensore. Ma possiamo chiedere a una macchina di implementare la nostra percezione del mondo.

Perché dovremmo interagire con un robot? Qual è lo scopo?

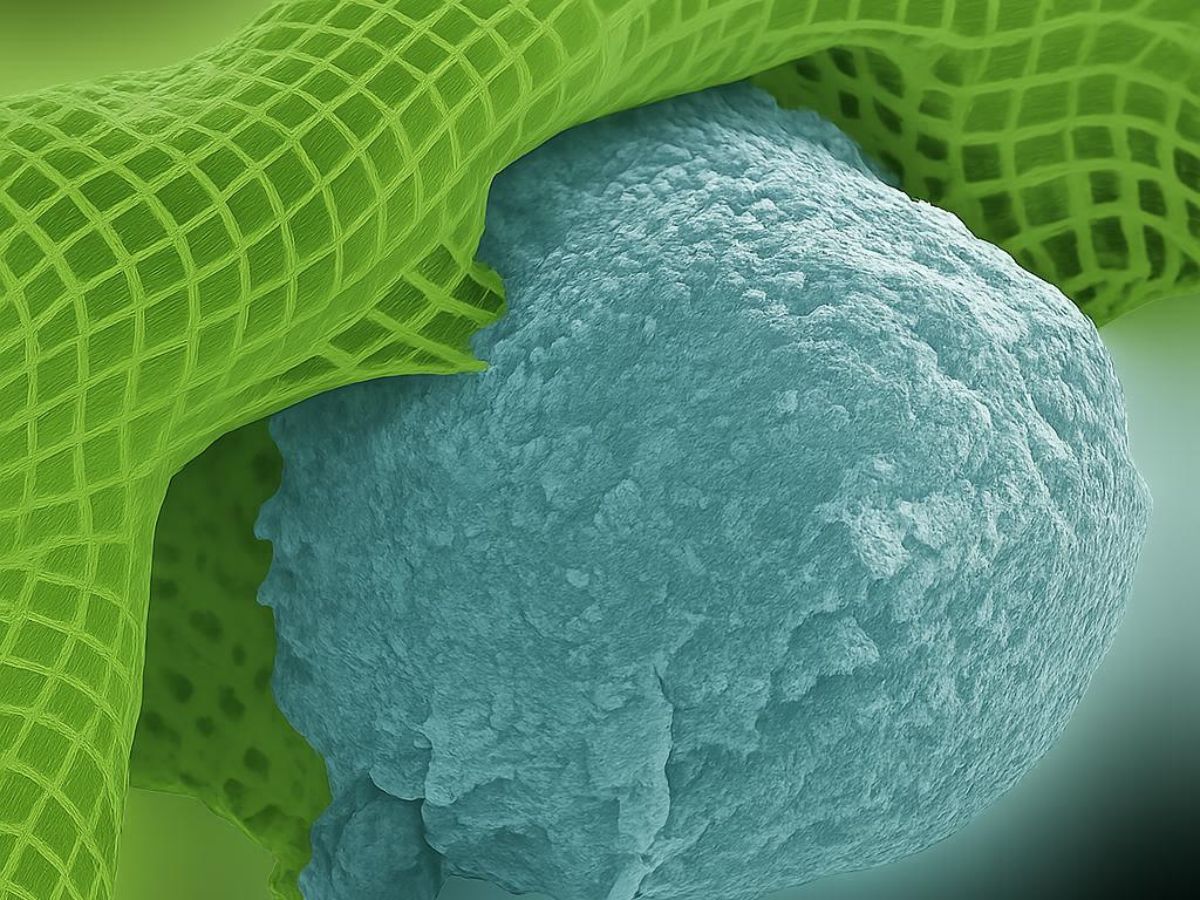

Questa possibilità di interagire è importante, per esempio, per chi ha distorsioni maggiori rispetto alla media, come nel caso dell’autismo, o più semplicemente della senilità. Nel nostro progetto, ci focalizziamo molto sugli anziani. Alcune ricerche recenti, infatti, suggeriscono che in particolare la percezione del tempo e in alcuni casi anche quella dello spazio possono cambiare con l’avanzare dell’età, perché si alzano le soglie percettive (si vede e si sente meno bene) e anche perché i meccanismi di ottimizzazione potrebbero funzionare in modo diverso. Questo può voler dire che, in alcuni casi, una persona anziana vive in un mondo diverso da quello in cui viveva prima e in cui vivono gli altri. L’idea è quindi quella di avere una macchina (un robot o una più semplice tecnologia) in grado di imparare da quella persona il suo modo di percepire e di conseguenza scegliere diverse strategie, come quella della riabilitazione, che cerca di far correggere le distorsioni, o un approccio assistivo, che adatta per esempio i tempi di azione di un braccio robotico per adeguarli alla percezione dell’anziano.